–مطالعه نگران کننده جدید نشان میدهد که چهرههای جعلی ایجاد شده توسط هوش مصنوعی (AI) قابل اعتماد است از افراد واقعی به نظر میرسند.

فرارو، آخرينهاي تاريخي استفاده از هوش چهرههاي انساني ايجاد كننده، اين چهرهها به قدري واقعي هستند كه آنها را راحتتر به اين چهرههاي ميكنند. این چهرههای جعلی به قدری متقاعدکننده هستند که حتی میتوانند ناظران آموزش دیده را نیز فریب دهند و برای کلاهبرداری بسیار قابل درمان باشند!

این چهرهها را میتوان به صورت آنلاین راحت کرد. سوفی نایتینگل از لینکستر میگوید: «ما باید نگران نباشیم، زیرا این برای پلید، مثلاً مستهجن قامجویانه هستند». برخی از برنامههای هوش مصنوعی با نام شبکههای متخاصم مولد یا با ایجاد، تشخیص تصاویر واقعی کار بسیار سخت است.

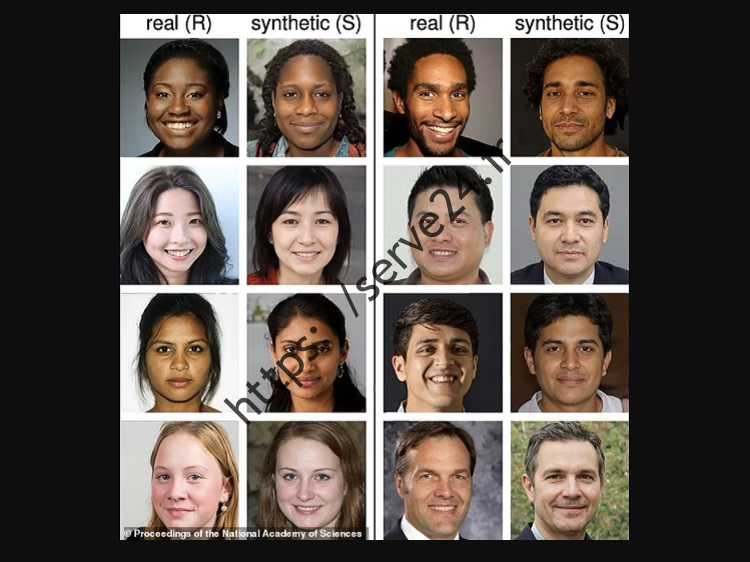

نایتینگل و همکارش در دانشگاه برکلی از 315 شرکتی که در یک وب سایت جمع آوری می کند که به آن ها ارائه می دهد. هر مجموعه متشکل از صد نفر از هر یک از چهار قومی سفید، پوست، آسیای شرقی و جنوب آسیا بود. این گروه دارای میزان دقت 48.2 درصد بود. به گروهی که از ۲۱۹ شرکت دوم تشکیل شد، چهرههای تولید شده توسط کامپیوتر آموزش داده شد. این گروه دارای میزان دقت 59 درصد بود، اما این تفاوت نسبت به گروه اول است.

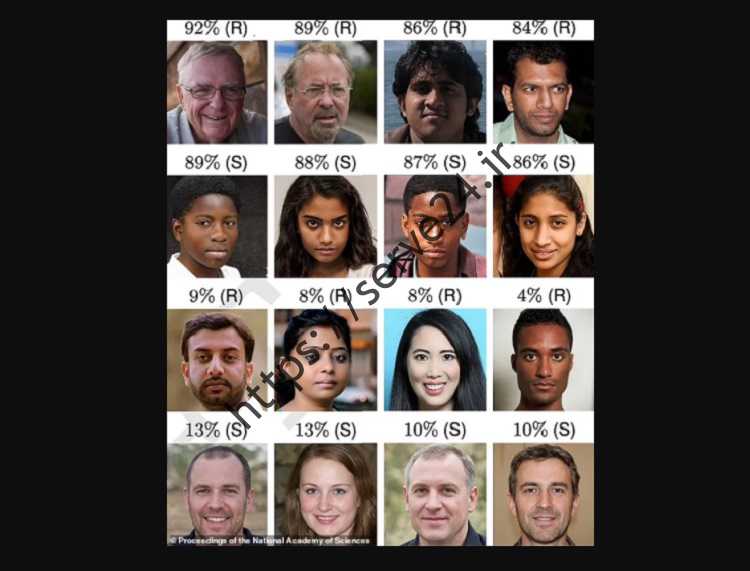

تشخیص چهرههای سفید برای مردم سختتر بود، شاید به این دلیل که نرمافزار سنتز برای چهرههای سفید بهطور مناسب آموزش داده نشده بود. همچنین از یک گروه متشکل از 223 شرکت کننده خواستند تا به طور واقعی که به آن ها نشان داده شود، 1 تا 7 امتیاز داده شود. آنها چهرههای جعلی را به طور متوسط 8 درصد قابل اعتماد نشان میدهند. گفته نایتینگل این یک کوچک، اما قابل بود. او میگوید که اشتباه در تشخیص ممکن است دلیلی باشد که چهرههای مصنوعی بیشتر شبیه چهرههای انسانها و به چهرههایی با ظاهر معمولی بیشتر اعتماد میشوند.

چهار چهره که بیش از همه غیرقابل اعتماد ارزیابی شده بودند، چهره های واقعی بودند. در حالی که سه چهرهای که امتیاز قابل اعتمادترین چهرهها را کسب کردند، در واقع چهرههایی جعلی بودند! نایتینگل میگوید: «ما در این زمینه به دستورالعملهای اخلاقی سختگیرانهتر و اصلاحهای قانونی بیشتر داریم، زیرا ناگزیر افراد میخواهند از این تصاویر آسیب ببینند، و این نگرانکننده هستند». او میگوید: «توسعهدهندگان برای کاهش این خطرات میتوانند واترمارکهایی را به کار گیرند تا آنها را جعلی معرفی کنند. ایدهی بدی به نمیرسد. اگر کاری برای جلوگیری از انجام آن انجام شود، فقط بدتر خواهد شد.»

: دانشمند خبر